Actualités

Actualités

Par Dominique Mollard

Administrateur d'IESF-Région Île de France

Retour sur terre après une vie dans les nuages : lIA « on the edge »

Lintelligence artificielle fête ses 70 ans et ses domaines de recherches tout comme des applications tendent à se stabiliser autour de quelques grands pôles, et parmi eux la reconnaissance visuelle et vocale tient le haut du pavé. Auparavant couronnée de succès pour sa reconnaissance du contenu dimages fixes, elle est capable désormais de traiter des flux avec des taux de réussite croissants. Elle nest pas la seule technique à se développer, comme en témoignent les nombreux progrès en traitement du langage naturel et ceux des algorithmes de classification qui permettent détablir des systèmes de recommandation. Lillustration la plus courante de la combinaison de ces techniques, et certainement très utile, est lutilisation dune application de traduction qui affiche en temps réel dans la langue de son choix ce que lappareil photo dun smartphone a sous sa lentille. Quelques imprécisions ne sont pas rares et les âmes sensibles nont quà bien se tenir car le traducteur se trompe parfois de façon surprenante en annonçant la composition dun plat.

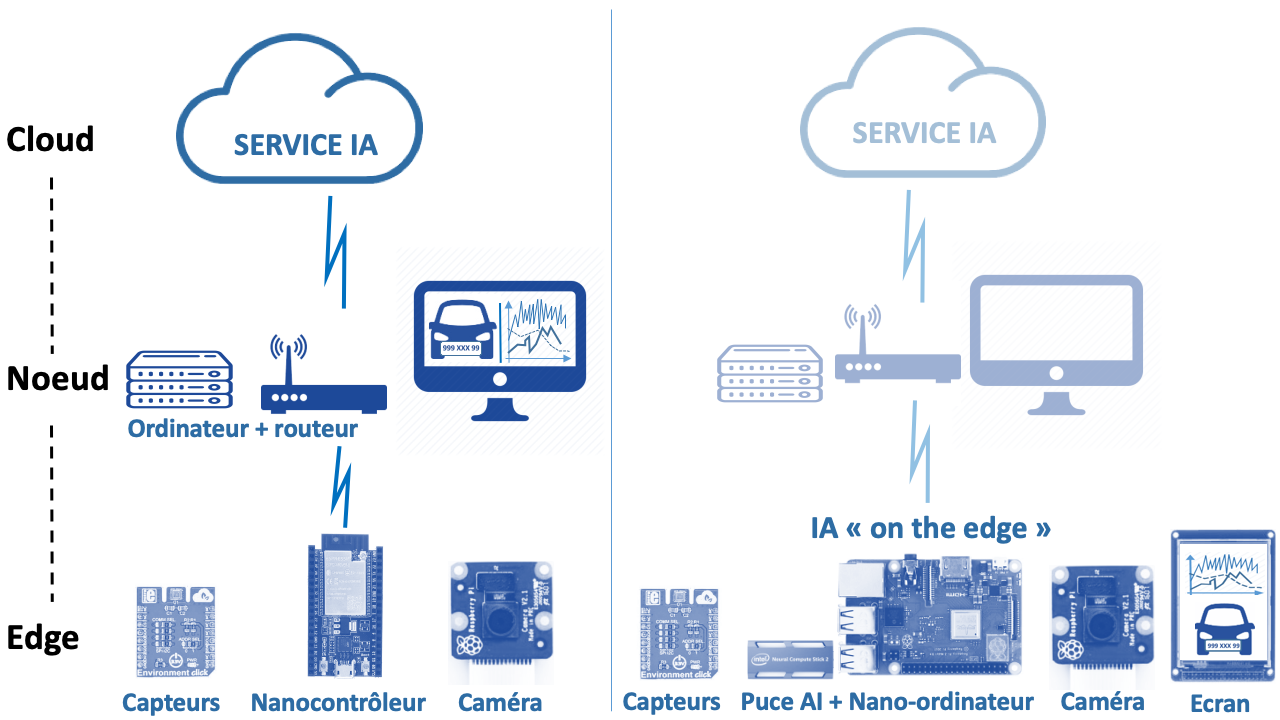

Mais, les touristes et les professionnels en mission le savent bien, cet accès à lintelligence artificielle ne va pas de soi. Il nécessite une connexion à un service distant via internet pour pouvoir utiliser un modèle déjà entraîné et dont le flux de données qui lui est transmis lui permet de restituer un résultat de manière quasi-immédiate. Cest la raison pour laquelle, lorsque notre abonnement mobile ne nous le permet pas, nous nous mettons en quête de la précieuse carte SIM qui sera le sésame pour linternet dans le pays daccueil. Ainsi, pas de réseau, pas dIA, ce qui est bien dommage. Cest pourquoi, depuis plusieurs mois, la capacité à réaliser des traitements dIA se déplace du cloud vers le terminal qui en a besoin, « on the edge » selon la formule, cest à dire sur les « extrémités » dune architecture informatique globale et hiérarchique qui jusquà présent était la règle. Laugmentation de la puissance de calcul des « terminaux mobiles », comprenons, des smartphones ou nano-ordinateurs tels que le Raspberry Pi, ne fait que croître sans contredire la loi de Moore mais en modifiant légèrement son ratio. Elle ne permet pas cependant une capacité suffisante pour « faire tourner » un modèle dont lentraînement a été réalisé par ailleurs. Or le besoin existe, ne serait-ce que pour doter un drone, un rover ou un équipement portable dune capacité de reconnaissance visuelle. Les ingénieurs, comme la nature dailleurs, ayant horreur du vide, ils ont mis au point des puces spécialisées point pour fournir la puissance de calcul additionnelle. Un article de la MIT Technology Review[1] décrivait il y a quelques temps, les avantages de ces composants et leur marché potentiel. Les fondeurs de puces accueillant des processeurs (Central Processor Unit ou CPU) et les fabricants de cartes graphiques (Graphics Processor Unit ou GPU) se retrouvent unis dans une architecture qui permet de démultiplier la capacité de traitement par laugmentation du nombre de curs (cores) pour lun et la parallélisation dun grand nombre de processeurs pour lautre. Lidée est dutiliser la puissance de calcul des processeurs graphiques pour réaliser des calculs sur des vecteurs et dappliquer le calcul tensoriel non plus à des données graphiques en 3D mais à tout type de donnée qui trouve ainsi une représentation commode pour des traitements de masse.

|

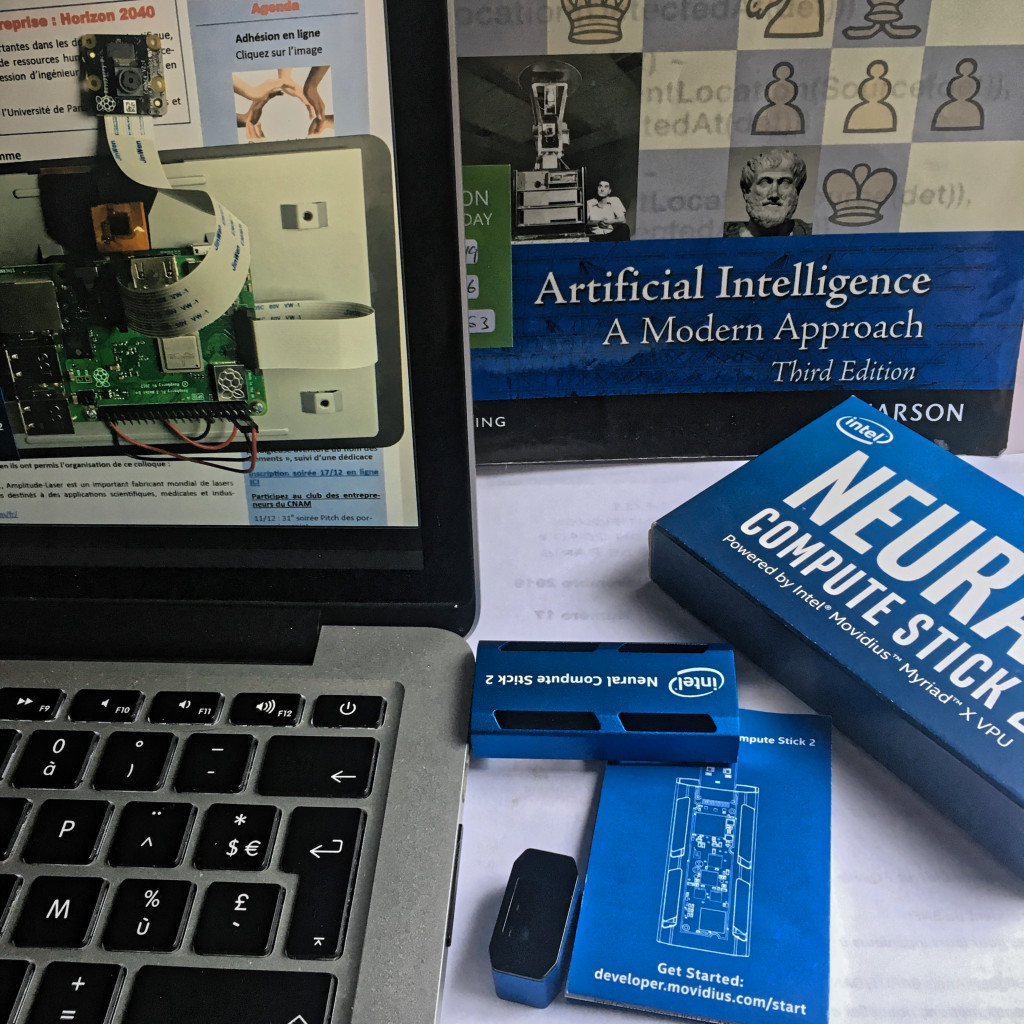

Le Neural Compute Stick 2 dIntel en appui dun Macbook Pro pour une IA Portable |

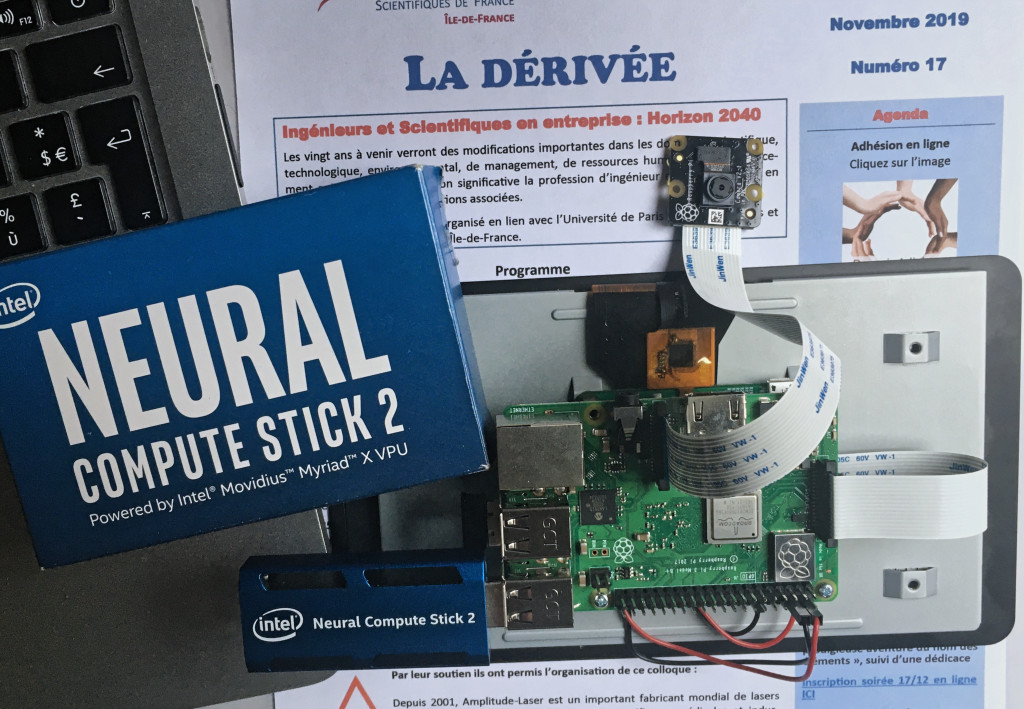

Dans ce but, des constructeurs comme Intel ont développé des circuits spécifiques, comme la Myriad X, en faisant évoluer un circuit GPU en VPU (Visual Processor Unit). Dotée de 16 processeurs graphiques, elle permet daccélérer les performances graphiques mais aussi dexécuter des modèles dapprentissage profond pré-entraînés avec une capacité de 1 TPOS (mille milliards dopérations par seconde) avec une consommation dénergie minimale et une connexion via un port USB. La « Neural Compute Stick » (photo ci-contre) prend la forme dune clé USB un peu massive et ajourée pour faciliter son refroidissement. |

Les métallurgistes ont ainsi conçu et fondu des puces ad hoc, que les électroniciens ont intégrés dans des circuits prêts à lemploi et économes en énergie. Il ne restait plus aux informaticiens quà mettre au point les architectures logicielles ou « frameworks » permettant den exploiter les possibilités et surtout de simplifier les flux de données en restant au niveau dune extrémité (edge).

Le modèle traditionnel hiérarchique peut ainsi être réduit à un équipement local et autonome pouvant exécuter un modèle pré-entraîné pour traiter en temps réel des flux de données produites par des capteurs.

|

LIA « on the edge » avec un nano-ordinateur Rapsberry Pi, dune puissance équivalente à celle dun PC, équipé dun Neural Compute Stick 2 dIntel, dune caméra et dun écran TFT tactile. |

Les possibilités de ces dispositifs sont très intéressantes et permettent par exemple de reconnaître automatiquement des éléments de lenvironnement, information précieuse pour les malvoyants par exemple, ou didentifier automatiquement et rapidement les défauts dune structure en se basant sur les images collectées en temps réel. Les outils logiciels permettent également dexploiter la puissance de calcul de ces modules pour réaliser des traitements du langage naturel, lu par la caméra ou enregistré par un microphone, avec le même principe dorganisation vectorielle des données et par extension de toute donnée pouvant être représentée sous la forme de tenseurs. Les tenseurs sont utilisés ici en tant quobjets conceptuels et techniques qui facilitent la représentation de fonctions de plusieurs variables sous la forme de tableaux à plusieurs indices.

En conclusion, larrivée à maturité de ce modèle et des composants qui limplémentent ouvre plusieurs possibilités aux ingénieurs en quête de modernité et de marchés. La première est dans la perspective de concevoir et de produire des puces électroniques dédiées aux calculs nécessaires aux algorithmes de lIA et de concurrencer celle dIntel, entre autres, par une offre fabriquée en France. La seconde, à défaut datteindre dans limmédiat cet objectif, est dutiliser des composants existants pour construire des systèmes mobiles, intelligents et de plus en plus intégrés. Une dernière, enfin, est dans la constitution de vastes réseaux de dispositifs « on the edge » dont les résultats de calculs pourraient être agrégés et digérés pour former des connaissances nouvelles. Ce serait une revanche de lIA « à lancienne », plus symbolique et basée sur des règles, sur lIA connexionniste des réseaux de neurones.

[1] Will Knight, « The chip leap forward », MIT Technology Review, 14 Décembre 2018

Accès au répertoire IESF

Accès au répertoire IESF